Il concetto di “metaverse as a computer platform” è centrale nell’approccio complessivo esposto da NVIDIA al Siggraph 2022. Il video dell’intervento coordinato da Jen-Hsun “Jensen” Huang, fondatore e CEO dell’azienda, è disponibile a questo link. Già nel concetto di computing troviamo che la centralità non è sugli avatar bensì sulle macchine.

Tutto sembra comunque considerato nei quattro punti elencati nella presentazione di :

- Nuovo linguaggio: USD by Pixar (nVidia Omniverse uses USD)

- Computing engine

- Omniverse: robotics as the next AI

- Avatars.

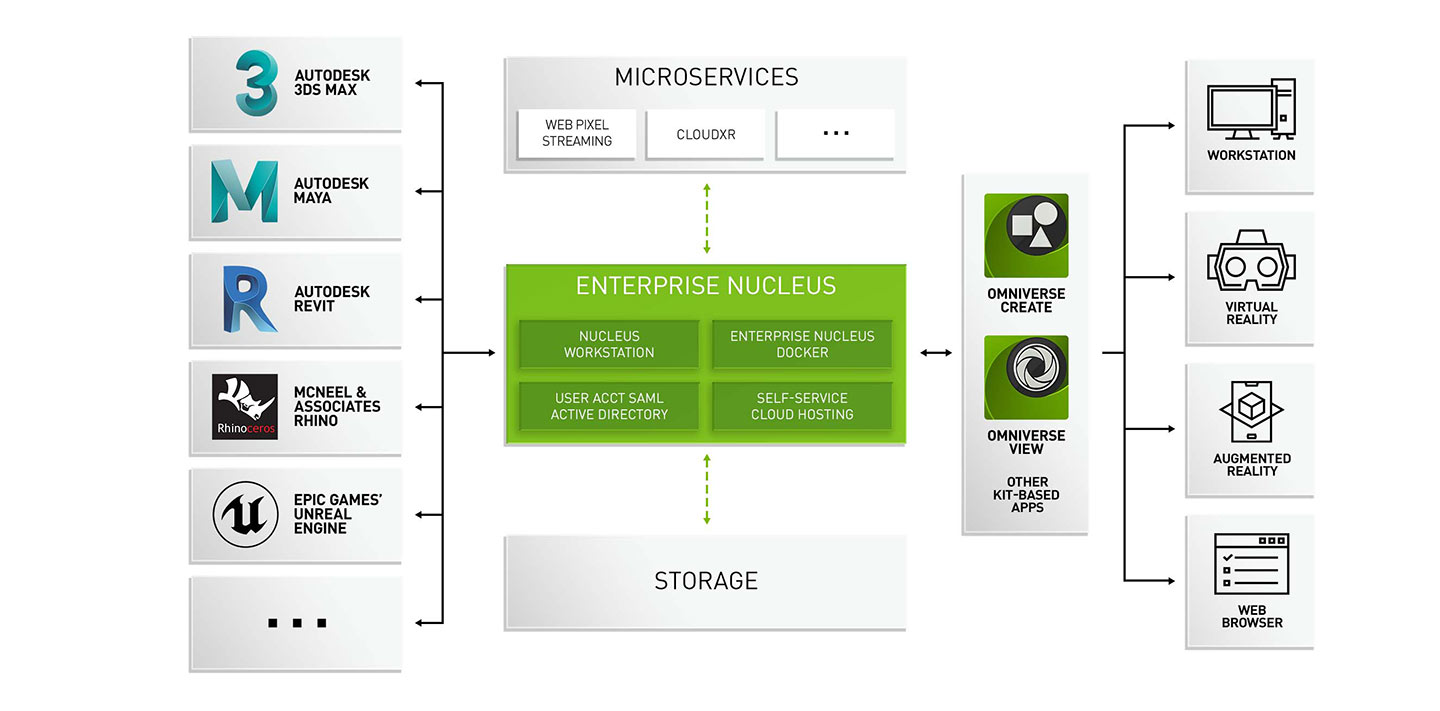

Di glFT ed USD ha già scritto Enrico Speranza. Qui ci soffermiamo sul cuore della strategia NVIDIA: Omniverse. Omniverse è una piattaforma collaborativa per la progettazione 3D e la simulazione realistica, in tempo reale, multi-GPU.

Al tempo stesso, riferendoci al metaverso non popolato da umani, OmniVerse può essere visto come un mondo di sensori. I sensori accedono ai dati e grazie a logiche umane (con USD) o automatiche (grazie all’intelligenza artificiale) risolvono problemi.

Dispositivi XR e robot agiranno da portali

Dimentichiamo il concetto di schermo più o meno interattivo come unica porta d’ingresso al multiverso. Veicoli e infrastrutture nelle smart cities, ma anche macchinari nelle smart factories e piantagioni nella smart agriculture sono i veri portali del cambiamento in atto. Device per realtà estesa e robot con sensori ed attuatori sono la nuova categoria di punti d’accesso alla Rete.

A ben pensarci, comunque, era così anche per gran parte dei servizi di qualsiasi fase di internet, regolati da software che non s’interfacciavano direttamente con gli umani né con i loro sensi.

Esistono già molti altri sistemi per generare e gestire mondi 3D. Parte della strategia di NVIDIA comprende la creazione di connettori con i software 3D. In particolare, un grande lavoro è in corso con Siemens Xcelerator per i Digital Twin. Per chi non lo conoscesse, Xcelerator è un portafoglio curato di hardware e software abilitati all’IoT (Internet of Things), un ecosistema di partner e un mercato. Non è l’unico strumento per i “gemelli digitali” considerato dalla mamma delle GPU.

In questo approccio alla visualizzazione, AI e grafica lavorano insieme, in tandem. Ma emergono alcune significative differenze tra mondo reale e mondi simulati: l’assoluta esecuzione delle leggi fisiche è necessaria, ma alle volte dev’essere possibile implementarle in forme più leggere o del tutto diverse.

Fashion e mobili, ma anche telcos e fabbriche: al centro di tutto è il digital twin. I limiti di questo approccio sono fantascientifici: Microsoft Flight Simulator è uno degli universi del metaverso e genera o gestisce un’enorme quantità di dati, compresi quelli metereologici che può ricevere ed usare in tempo reale, come se esistesse un digital twin della Terra. Addirittura più intrigante l’azione di NVIDIA, che sta sviluppando un vero e proprio digital twin della Terra.

Le risorse necessarie richiedono un particolare efficientamento anche nell’uso della memoria per immagini grafiche a più dimensioni. Il passaggio ad un livello prestazionale superiore, come ad esempio quello necessario per elevarsi dalla modellazione scientifica a quella medica, passa per l’Efficient Memory Representation di dati volumetrici o VDB, volumetric data bases. Partito dall’Open VDB, poi diventato Neural VDB, è stato ulteriormente migliorato nel Nano VDB GPU Accelerator, rilasciato nel 2021.

[…] Andando più in dettaglio, ciascun meta-space viene costruito su quattro livelli: “feature point“, “geometric structure“, “realistic texture” ed “object semantic“. La struttura dello spazio viene descritta da punti rilevanti, riconoscibili da visori e robot, sui quali viene imposta una struttura per linee, successivamente renderizzata grazie a texture realistiche. A questo punto viene dato un ruolo a ciascuno degli oggetti.Sottolineiamo che questa strutturazione si riferisce solo al cosiddetto “metaverso industriale”, senza avatar per umani. Questo concetto rimbalza da più fonti come già disponibile (vedi gli annunci di NVIDIA). […]